Si quieres protegerte contra los efectos del Alzheimer, unas de las mejores cosas que puedes hacer es aprender otro idioma. Al menos eso se desprende de un reciente estudio cerebral que muestra que los cerebros de las personas bilingües funcionan mejor y durante más tiempo, tras desarrollar la enfermedad.

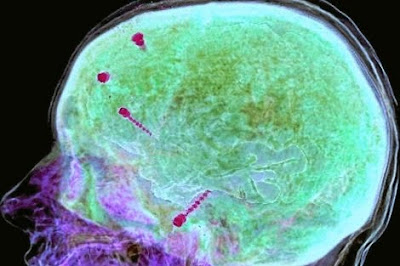

El estudio lo realizó la psicóloga Ellen Biaslystok y sus colegas de la Universidad de York en Toronto (Canadá), que monitorizó los cerebros de 450 pacientes diagnosticados con Alzheimer mediante tomografía axial computarizada (CT). La mitad de estos pacientes eran bilingües, y la otra mitad solo hablaba un idioma.

Todos los pacientes tenían un nivel cultural similar. Los investigadores descubrieron que la media de edad a la que se diagnosticaba el mal a las personas bilingües era cuatro años superior a la de los monolingües.

Su hallazgo se publicó el 18 de febrero durante la reunión anual de la Asociación Americana para el Avance de la Ciencia.

Curiosamente, los CT mostraron que en pacientes que parecían atravesar el mismo grado de enfermedad, los bilingües mostraban un deterioro mental mayor que los que solo hablaban un idioma. No obstante, esta diferencia no era aparente desde el punto de vista del comportamiento del paciente, o en sus habilidades para operar. Las personas bilingües actuaban igual que los pacientes monolingües cuya enfermedad estaba menos avanzada.

Al parecer la explicación a este efecto protector podría tener que ver con cierta red cerebral llamada sistema de control ejecutivo que parece ser la base para nuestra habilidad de pensar en formas complejas, y que controla la atención y todo aquello que hace único al pensamiento humano.

Según esta teoría, las personas bilingües tienen que ejercitar constantemente este sistema cerebral para evitar que uno de los dos lenguajes que dominan interfiera con el otro. Sus cerebros deben hacer búsquedas a través de varias opciones (en ambas lenguas) para elegir cada palabra, lo cual confiere a sus cerebros un beneficio cognitivo.

Tal y como comentan los científicos, no es que el bilingüismo evite la enfermedad, sino que hace que un paciente se maneje con ella de forma más eficiente.

Esto no solo funciona con personas que viven en áreas bilingües como Quebec o Cataluña, sino que también es útil para aquellos que como yo, aprendimos un idioma extranjero siendo jóvenes.

Me enteré leyendo Livescience.

Fuente:

Maikelnais Blog